האשליה הנוחה

נניח שאתה פותח את ספוטיפיי בבוקר. בחמש שניות כבר מתנגן שיר שלא ידעת שאתה רוצה לשמוע – ובכל זאת, הוא בדיוק מה שהיית צריך. נניח שאתה מדפדף בנטפליקס אחרי עבודה, ותוך רגע אתה שוקע בסדרה שלא תכננת לראות. נניח שאתה פותח את הפיד בבוקר ואתה כבר יודע שאין שם שום דבר שבאמת יעניין אותך – אבל ממשיך לגלול בכל זאת.

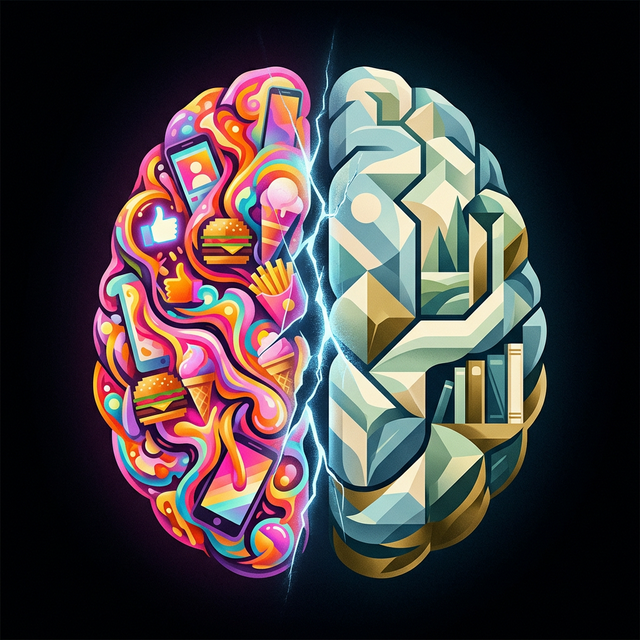

הסיפור שאנחנו מספרים לעצמנו הוא פשוט: "אנחנו בחרנו". השתמשנו בטכנולוגיה כדי לגלות את מה שאנחנו אוהבים. האלגוריתם הוא רק עוזר, שירות, מראה שמשקף את הטעם שלנו לעצמנו. אנחנו הנהגים. האלגוריתם הוא GPS.

אבל מה אם הנרטיב הזה שגוי? מה אם אנחנו, מאז שנות האלמות של הפלטפורמות, לא ממש בחרנו – אלא רק ענינו לשאלות שמישהו אחר ניסח עבורנו?

הניסוי שחשף את הפער

בשנת 2023 פרסמו חוקרים מבית הספר לניהול של UCLA ועמיתיהם מאוניברסיטת סטנפורד מחקר יוצא דופן ב־Scientific Reports. הם לא שאלו "מה גורם לאנשים להקליק על מודעה?" – שאלה שכל חברת טכנולוגיה שואלת בכל שנייה. הם שאלו שאלה אחרת לגמרי: "מה אנשים רוצים כשהם מקליקים על מודעה?"

את ההבחנה הזו הם כינו "העדפה אמיתית" מול "העדפה אידיאלית". האחת – מה שאתה עושה; השנייה – מה שאתה שואף לעשות. הם בנו שתי מערכות המלצות חיות: אחת שלמדה ממה שאנשים לוחצים עליו, ואחת שלמדה ממה שהם הצהירו שהם רוצים לקרוא.

התוצאה הייתה מדהימה ומלחיצה בו-זמנית. אנשים שקיבלו המלצות "אמיתיות" – כאלה שתאמו את ההתנהגות שלהם – לחצו עליהן ב־52% מהמקרים. אנשים שקיבלו המלצות "אידיאליות" לחצו רק ב־40%. *(מקור: Khambatta et al., Scientific Reports, 2023)* אבל כשבדקו איך אנשים הרגישו אחרי שקראו? הסדר התהפך לגמרי. מי שקרא תוכן אידיאלי דיווח שהרגיש טוב יותר, שזמנו הושקע נכון, שהחברה ששירתה אותו דואגת לו. מי שקרא תוכן שהוא "אמיתית" רוצה הרגיש שהזמן בוזבז.

"אנחנו מוצאים שמיקוד המלצות אלגוריתמיות בהעדפות האמיתיות של אנשים, ולא באידיאליות שלהם, מייצר יותר קליקים – אך לא גורם לאנשים להרגיש טוב יותר, ואף עשוי להוביל לתוצאות שליליות מבחינת רווחה." – Khambatta, Mariadassou, Morris & Wheeler, Scientific Reports, 2023

כלומר: בכל הפלטפורמות הגדולות, הדבר שנמדד הוא ה"לאיזה כיוון אתה נוסע" – לא "לאן אתה רוצה להגיע". מנגנון ה־engagement הוא מנגנון שממקסם ביקור, לא צמיחה.

מתמטיקת הסחף: כמה קטן מייצר כמה גדול

אפשר לחשוב על בועת הפילטרים כעל תופעה שמגדילה משהו קטן לממדים לא מידתיים. המחקר האקדמי שנבנה סביב זה הוא דרמטי יותר ממה שהתקשורת המיינסטרים מציגה.

חוקרים גרמניים דגמו רשתות חברתיות במודל מבוסס-סוכנים ומצאו שהטיה זעירה בהמלצות – כזו שרוב המשתמשים לא ישימו לב אליה – מספיקה להניע מדרון קיטוב ברמת הרשת כולה. *(מקור: Geschke, Lorenz & Holtz, British Journal of Social Psychology, 2019)*

זה לא תכנון מכוון. לא עלילה של חברות טכנולוגיה שיושבות בחדרי מלון חשוכים ומחליטות לקטב את האוכלוסייה. זה פשוט איך שהמתמטיקה עצמה נוסעת כשהמטרה היחידה שלה היא – להשאיר את המשתמש בכל מחיר. כי תוכן שמטלטל, מכעיס, ומקנה תחושת "הבנת משהו שאחרים לא יודעים" – מייצר יותר מעורבות. ותוכן שמייצר מעורבות – מייצר לערוצי הסושיאל יותר כסף.

במחקר שיטתי שפורסם ב-Societies ב־2025 על 30 מחקרים שנותחו לאורך עשר שנים – עולה תמונה ברורה: אלגוריתמים מגבירים הומוגניות אידיאולוגית בצורה מובנית. לא מקרית. לא כתופעת לוואי. מובנית. *(מקור: Ahmmad, Shahzad, Iqbal & Latif, Societies, 2025)*

כששואלים: "האם הדעה שלי נוצרה ממה שאני חושב?" – התשובה המדעית היא: "חלקית". חלק ממנה נוצרה מטעמך. חלק גדול נוצר מהאינטרסים של הפלטפורמה.

האלגוריתם לא מנחש – הוא מעצב

ישנה טענה נפוצה שאלגוריתמים של המלצות הם כלי ניטרלי: הם מנחשים מה אתה כבר רוצה ומציגים לך את זה. לפי הגיון זה, הטעם שלך הוא נקודת המוצא; האלגוריתם פשוט עוקב אחריו. אבל יש בעיה עמוקה עם ההגיון הזה. כדי לנחש מה תרצה בעתיד, האלגוריתם מסתמך על מה שעשית בעבר. ומה שעשית בעבר – לפחות חלקו – הוא עצמו תוצאה של המלצות אלגוריתמיות שקיבלת. זה מעגל. המלצה שנייה נוצרת בחלקה מהמלצה ראשונה. המלצה עשרים נוצרת בחלקה מתשע עשר ההמלצות שקדמו לה.

כינוי טכני לתהליך הזה הוא "drift" – סחף. YouTube הראו בניתוחים שלהם עצמם, שמשתמשים שמתחילים עם תוכן מסוים, אפילו מתון, נסחפים בהדרגה לתוכן יותר קיצוני – פשוט מפני שהוא מייצר יותר מעורבות. *(מקור: Cakmak, Agarwal & Oni, Social Network Analysis and Mining, 2024)*

כאן נכנסת שאלה פילוסופית לגיטימית: אם ה"ביקוש" שלך נוצר בחלקו ע"י ה"היצע" שהוצג לך – מה בדיוק משקף האלגוריתם? את ה"אני" האמיתי שלך, או את הנגזרת המתמטית שנבנתה בתוך סביבת הפלטפורמה?

זה לא שאלה תיאורטית. כשאמזון מציגה לך מוצרים, היא לא רק מנחשת מה תרצה לקנות – היא ממש מעצבת את הרצון הזה. כשטיקטוק מציג לך תוכן, הוא לא רק מזין תשוקה קיימת – הוא מגדל תשוקות חדשות מתוך הזרע הקטן שמסרת לו "בבחירה" האחרונה שלך.

"רשתות חברתיות פועלות על ניתוח של התנהגות המשתמש – לחיצות, שיתופים, זמן שהייה – כדי לחזות ולהמליץ על תוכן התואם התנהגויות אלו. ואם כי זה מעצים את הנוחות והרלוונטיות, הוא עלול בו־זמנית להגביל חשיפה לפרספקטיבות מגוונות." – Ahmmad et al., Societies, 2025

פרדוקס המעורבות: כשהעסק מנצח ואתה מפסיד

יש דבר מרתק שקורה כשמבינים את מנגנון ה־engagement: מסתבר שהאינטרס של הפלטפורמה ואינטרס המשתמש הם ניגוד מבני. לא בהכרח מכוון – אבל מבני.

הפלטפורמה מרוויחה כשאתה ממשיך לגלול. לכן האלגוריתם ממקסם את הסבירות שתמשיך לגלול. אבל "להמשיך לגלול" ו־"להרגיש טוב ממה שראית" הן שתי פונקציות שונות – ומתברר שלפעמים הן מנוגדות לחלוטין.

מחקר מ־2020 שבחן את ה־"רווחה הנפשית" שמניעה מדיה חברתית מצא שביטול הפייסבוק לחודש אחד שיפר את מצב הרוח המדווח של אנשים, הפחית קיטוב פוליטי, וגרם להם לבלות יותר זמן בפעילויות offline. *(מקור: Allcott, Braghieri, Eichmeyer & Gentzkow, American Economic Review, 2020)*

כלומר: המוצר שהפלטפורמות מוכרות – "חיבור", "גילוי", "בידור" – הוא לפעמים כסות לממכר שמנוגד לאינטרסים שלנו. לא כי הן רעות. אלא כי ה־incentive structure שלהן מתגמל מעורבות ולא רווחה.

ואנחנו, כצרכנים, אנחנו מבלבלים בין "זה גורם לי להמשיך" לבין "זה טוב עבורי". הנאה רגעית נחווית כערך. הסחף מרגיש כבחירה. והפלטפורמה מעוניינת שנמשיך לבלבל באין אלו לאלו.

כשגללנו חמישים פוסטים ב־Instagram בלי שתכננו, לא היה זה בחירה. היה זה תוצאה של ממשק שתוכנן על ידי מומחי שכנוע, שסיפק גירויים קבועים כדי לשאול את מוח ה"תגמול" שלנו אם לא כדאי לגלול שוב. הבחירה נשדדה בשקט.

האם יש מוצא? (ותשובה לא נוחה)

כאן הדיון מתפצל בדרך כלל לשניים: אלה שאומרים "הפיתרון הוא רגולציה" ואלה שאומרים "הפיתרון הוא חינוך דיגיטלי". שניהם נכונים חלקית. שניהם מפספסים משהו מהותי.

הסקירה השיטתית של 30 מחקרים שהוזכרה קודם מציינת שהטיפול ב־"מוגבלות אלגוריתמית" דורש גישה כפולה: רפורמות מבניות בממשל פלטפורמות ועם זאת השקעה בחינוך אוריינות אלגוריתמית – לא רק "איך לזהות פייק ניוז" אלא "איך להבין שהפיד שלך מעוצב לפי אינטרסים שאינם שלך". *(Ahmmad et al., 2025)*

ה־EU עשתה צעד נועז עם ה-Digital Services Act שמחייב שקיפות גדולה יותר מאלגוריתמים. אבל הגנות ספציפיות לרווחת המשתמש – לא רק מניעת תוכן מזיק – עדיין לא מוסדרות מספיק.

ומחקר סטנפורד 2023 מציע שינוי פרדיגמה פשוט יחסית אך עמוק: אלגוריתמים שממקסמים "מה שאתה שואף להיות" ולא "מה שאתה עושה ברגע זה". לא טוטליטריזם פטרנליסטי – אלא אפשרות שתגדיר לאלגוריתם מה ה־"אני" שאתה רוצה שהוא ישקף, לא רק מה הוא הצליח לסחוב ממך בחמש הדקות האחרונות.

אבל הפיתרון האמיתי עמוק יותר. הוא פילוסופי.

חופש בחירה אינו רק ההיעדר של כפייה חיצונית. הוא גם נוכחות של מודעות פנימית. לבחור באמת פירושו לדעת מתוך מה אתה בוחר. ואם אינך יודע שהפיד שלך, המנגינה הבאה, המוצר המוצע – כולם תוצרים של פונקציית engagement ולא של ה־"אני" – אז אתה בוחר במסדרון שציירו עבורך, תחת האשליה שזהו העולם כולו.

תגובות

כדי להשאיר תגובה, יש להתחבר לחשבון

התחברות | הרשמה